ריאיוןבכירה במיקרוסופט: "נראה יותר מבצעי השפעה שיוזמת איראן נגד ישראל"

ריאיון

בכירה במיקרוסופט: "נראה יותר מבצעי השפעה שיוזמת איראן נגד ישראל"

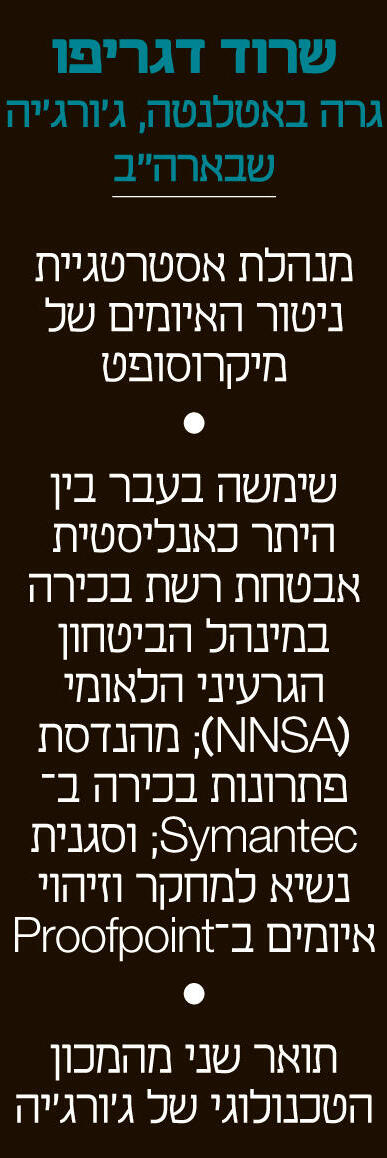

"מדינות רודניות מנצלות את ChatGPT לצורכיהן" • "אין מה לסמוך על הרשתות החברתיות שיטפלו בשיח שנאה” • "מוסדות פגיעים יותר מיחידים לנזקי בינה מלאכותית" • שרוד דגריפו, מנהלת אסטרטגיית ניטור האיומים של מיקרוסופט, מתריעה שתוכנה היא דבר שברירי ומסבירה למה ראוטר ישן הוא המכשיר הכי מסוכן בבית

שרוד דגריפו, את מנהלת אסטרטגיית ניטור האיומים של מיקרוסופט, והדוברת המרכזית בכנס בלוהאט שנערך בישראל בשבוע שעבר. החברה פרסמה בפברואר דו"ח נרחב על מתקפות הסייבר של איראן נגד ישראל מאז 7 באוקטובר. מה המגמות שזיהיתם שם?

"במשך שנים אני חוקרת את האיראנים כשחקני איום — Threat Actors, גופים, ארגונים או יחידים שגורמים נזק מכוון לחומרה או למערכות דיגיטליות. איראן היא אחת מארבע הגדולות בתחום לצד סין, רוסיה וצפון קוריאה. אלו המדינות עם התוכניות שנחשבות למפותחות וליעילות ביותר. איראן תמיד היתה מעניינת במובנים רבים מכיוון שהיא מתקדמת טכנולוגית אבל גם מבודדת כלכלית ודיפלומטית בגלל הסנקציות. זה יצר עבורה חופש והזדמנות באמת להיות מסוגלת לעשות מה שהיא רוצה בכל הנוגע לסייבר, כי מה עוד יעשו לה בתגובה?

"אחרי 7 באוקטובר איראן מיקדה וגייסה את כל מערך מתקפת הסייבר שלה נגד ישראל, כחלק מהתמיכה שלה במאמצי המלחמה. זה כולל דברים כמו מתקפות כופר ומחיקת מידע, אבל גם מבצעי השפעה, בזה הדו"ח עוסק בעיקר. עד סוף אוקטובר הם היו ממוקדים לחלוטין במבצעי השפעה שתומכים בחמאס. בדרך כלל הם לא משנים מיקוד באופן מהיר, אבל כאן הם העבירו משאבים מיידית למאמץ הזה".

תני דוגמאות.

"הם, למשל, שלחו הודעות טקסט לחיילים ישראלים שאמרו 'אתה צריך פשוט ללכת הביתה, אתה צריך להפסיק את זה. זה לא שווה לך. לך תהיה עם המשפחה שלך. אתה לא צריך להתעסק בזה'. הם ניסו להשפיע על הלך הרוח של האנשים בשטח. הם ידועים גם במבצעי השפעה שכוללים ניפוח והגזמה של מה שהם עשו בפועל. למשל, הם טענו שיש להם שליטה על כל מצלמות האבטחה בבסיסים צבאיים שונים — ולא היה להם את זה. אז זה שילוב של הישג סייבר קטן עם מבצעי השפעה גדולים במדיה חברתית, כדי לגרום לזה להיראות כאילו חדרו באופן עמוק. הדו"ח הבא שלנו יתפרסם בספטמבר, ואני חושבת שנראה דגש גדול עוד יותר על מבצעי ההשפעה שיוצאים מאיראן, שהמטרה שלהם היא להשפיע על משתמשים במערב להיות נגד המלחמה ונגד ישראל".

"גופים מאיימים ותוקפניים יכולים היום להיכנס למערכות בשקט, וקשה מאוד לזהות אותם. זה מראה ששרשרת אספקת התוכנה כל כך פגיעה"

אנחנו מבחינים ברשתות חברתיות בפעילות ענפה של בוטים איראניים שמתחזים לאזרחים ולארגונים ישראליים משני קצות הקשת הפוליטית, ומפיצים מסרים שמנסים לשסע את החברה הישראלית. איך זה שפלטפורמות כמו פייסבוק עדיין לא מטפלות כמו שצריך בסוגיה?

"זו בעיה שמשתוללת ברשתות החברתיות. בארה"ב העיקרון של חופש ביטוי מאוד משמעותי ולכן יש ויכוחים על המדיניות הרצויה ברשתות חברתיות. אנחנו חייבים למצוא להן תמריץ לטפל בבעיה, כי מבחינתן תעבורה זו תעבורה; ופוסטים וצפיות יוצרים את התמריץ הכספי. לכן כשבוטים מפרסמים פוסטים שמעוררים זעם ושנאה ומושכים אש, בעלי הפלטפורמות מפיקים מכך תועלת. ולסמוך עליהם שיטפלו בזה — אין טעם. ל־X (טוויטר) יש בעיית בוטים משתוללת, כיום בעיקר של פורנו. אבל זה יכול בקלות להפוך לתשתית לקמפיינים להשפעה פוליטית".

בואי נדבר על איומי סייבר ובינה מלאכותית גנרטיבית (GenAI). מה ראית בשנה וחצי שחלפו מאז ההשקה הפומבית של ChatGPT, הכלי שיצרה OpenAI, השותפה המרכזית שלכם בתחום הבינה המלאכותית?

"בשיתוף עם OpenAI בחנו מה עושות בתחום סין, רוסיה, צפון קוריאה ואיראן. מצאנו שלכל ארבע המדינות יש תוכניות שמשתמשות בכלי GenAI. שחקני האיום ממנפים את ChatGPT ככלי לצורכיהם, באותו אופן שבו כל אחד מאיתנו ישתמש בו ככלי לצרכיו. אני משתמשת ב־ChatGPT כמעט כל יום לכל דבר: דברים אישיים, דברים בעבודה. אני משתמשת בו כל הזמן. אז המדינות הללו גם משתמשות בו למטרותיהן".

איך למשל?

"למשל, גוף שבסיסו ברוסיה חוקר ב־GenAI טכנולוגיות לווייניות. לרוסיה יש היסטוריה ארוכה של מאמצים לשבש פעילות בלוויין, לשבש תקשורת או ליירט תקשורת, כדי לאסוף מודיעין. ראינו אותם גם עושים מחקר על כוח אדם, הם בדקו באילו תפקידים אנשים נמצאים ובמשך כמה זמן. ניתן להשתמש במידע הזה במגוון דרכים, אבל אנחנו חושדים שהמאמץ פה ממוקד בהנדסה חברתית — שימוש בגישות התנהגותיות לשם קביעת מדיניות או עיצוב במבנה החברתי; או כדי להתחזות לאנשים שאותם הם חוקרים".

הם גם מבקשים מ־ChatGPT לייצר עבורם טקסטים בשפות שונות ובהתאמה לקהלי יעד שונים, למשל לצורך מבצעי השפעה?

"ראינו אותם יוצרים תוכן של הנדסה חברתית, אבל לא ראינו אותם משתמשים בזה עדיין במסגרת התקפה. בשלב זה הוא משמש יותר ככלי למחקר, מעין קבלת דריסת רגל והבנה בדברים של שפה ותרבות. גם לא ראינו שימוש בכלי הזה לכתיבת קוד לתוכנות זדוניות. מצד שני, זה כלי היצירה — אז קשה לומר בוודאות. אי אפשר לדעת אם קוד נוצר על ידי ChatGPT או על ידי המפתח עצמו".

איך ממתנים סיכונים מסוג זה?

"מחקנו את כל החשבונות שזיהינו. חסמנו את הגישה שלהם".

זה היה אחרי החקירה. כיצד אפשר למנוע?

"אנחנו מאוד פרו־אקטיביים בבטיחות ובאחריות בכל הנוגע לבינה מלאכותית. אני חברה טובה של ראש ה־Red Team לבינה מלאכותית במיקרוסופט (צוות ארגוני שתפקידו לחשוב כשחקן איום ולנסות למצוא כשלים, פרצות ונקודות חדירה במערכות מחשב — ע"כ). זה צוות שלם שפשוט מנסה לגרום למגוון פלטפורמות בינה מלאכותית בתוך מיקרוסופט להגיב בדרכים שהן לא צריכות. אם אתה שחקן איום ויש לך אמצעים שבעזרתם אתה יכול ליצור אינטראקציה — אתה מסוגל לגרום לדברים רעים לקרות. אז יש לנו צוות של אנשים שמוודא שה־AI לא עושה דברים שאינה אמורה לעשות, כמו דברים שיהיו מסוכנים לקטינים או דברים שיאפשרו ליצור נשק".

"מאז 7 באוקטובר האיראנים ניסו להשפיע על הלך הרוח של החיילים שנמצאים בשטח. שולחים להם מסרים שיעזבו את החזית ויחזרו הביתה"

מה למשל הצוות הזה מנסה לגרום ל־AI לעשות?

"לבקש ממנו נוסחה לנשק כימי. לשאול אותו דברים כמו, 'אני רוצה לגרום לילד לעשן סיגריות. מה אני אומר לו?'. או, למשל, 'מה הדרך היעילה ביותר לשדוד בנק? תדריך אותי צעד אחרי צעד'. אלו דברים שאנו רוצים להיות מסוגלים למנוע ממוצרי AI. אנחנו רוצים שהמוצרים הללו ישמשו כדי ללטש את התסריט שלך וליצור גרפיקה שתוכל להשתמש בה במצגת, ודברים פרודוקטיביים. באוקטובר גם השקנו תוכנית ראשונה לאיתור באגים במוצרי AI. אם תמצא באג בינה מלאכותית של הנדסת שאילתות באחד מהמוצרים של מיקרוסופט, תקבל על כך פרס כספי".

לפני שבועיים, שני אנשי הבטיחות והאמינות של OpenAI, איליה צוסקבר ויאן לייקה עזבו, והחברה סגרה את הצוות שהוביל את המחקר בנושא. נראה שהחברה פחות מחויבת לפיתוח בינה מלאכותית בטוחה, שקופה ומועילה מכפי שהיינו רוצים.

"אני לא יכולה להתייחס למחויבות של OpenAI, אבל המחויבות של מיקרוסופט היא 100%".

אבל היא שותפת ה־AI המרכזית שלכם. מרבית מוצרי הבינה המלאכותית האינטראקטיבית מבוססים על המודלים של OpenAI. אתם לא מודאגים מכך שהשותפה שלכם לא מחויבת לסוגיה?

"אני לא מודאגת ממה שמיקרוסופט משחררת, כי אנחנו עושים כל כך הרבה בדיקות. אנו בודקים לעומק את המוצרים שלנו ואת הקוד שאנו משלבים שיצר כל שותף שלנו. מוצר שיש עליו את השם של מיקרוסופט — אנחנו לוקחים עליו אחריות וזה עובר דרך כל צוותי הבטיחות שלנו".

גם שחקני איום מפתחים מודלים של AI לא בהכרח בצורה אחראית. למשל, מודלים שמפותחים בסין ויכולים להיות מנוצלים לרעה — איך מתגוננים מפניהם?

"זו שאלה שאנחנו חושבים עליה כבר שנתיים בערך. במיקרוסופט אנחנו משתמשים בבינה מלאכותית כדי לאתר מתקפות. אנחנו עושים את זה כבר שנים, רק שלא ממש עשינו מזה עניין גדול. אנחנו עושים שימוש במדעי נתונים, למידת מכונה ובינה מלאכותית במוצרי זיהוי האיומים שלנו כבר זמן רב. בתור משתמש, אתה יכול להפעיל את אותו סוג אבטחה כמו תמיד: להוריד עדכונים אוטומטיים של מיקרוסופט, לא לשלוח דברים שאתה לא צריך לשלוח, ולא ללחוץ על דברים שאסור ללחוץ עליהם.

"בנוגע לארגונים, הם במיוחד יצטרכו להתמקד בסביבה שבה פועלת הבינה המלאכותית. האם הכלים הללו אחראיים? האם הם בטוחים? איזו AI יש בסביבה שלנו והאם נוכל להגן על השימוש בה? אם ארגון נותן הלוואה על סמך המלצת בינה מלאכותית, האם הוא עומד בתקנות מתן הלוואות? אלה דברים שאנשים יצטרכו להבין".

מהן מתקפות הסייבר הנפוצות ביותר כרגע?

"כרגע אנחנו רואים שסין מחפשת מכשירי קצה: ראוטרים, במיוחד בבתי מגורים. כי אם הם יכולים לפרוץ לראוטר ביתי, הם יכולים להפעיל את ההתקפות שלהם ממה שנראה כמו כתובת IP פרטית, מה שמספק יכולת הסתרה מסוימת".

אז המטרה היא לא הבית עצמו?

"זה כמו פלטפורמה שדרכה אפשר לשגר מתקפה דרך שרשרת האספקה: אם אני מצליחה לפרוץ לראוטר הביתי שלך, אז אני יכולה להתנהג כאילו אני מגיעה מכתובת IP מקומית. זה לא יפעיל שום אזעקות, וזה מקשה מאוד את המעקב או זיהוי מקור המתקפה. והסיבה שזו בעיה כל כך גדולה היא שאנשים לא מעדכנים את הראוטרים שלהם".

מה האיום הגדול הבא שאנחנו צריכים להיות מודאגים ממנו?

"קשה לשער דברים כאלה. אתה אף פעם לא יכול לדעת מה שחקני איום עומדים לעשות. אני מאמינה שרובם יעשו את המינימום שהם צריכים כדי להצליח מבלי להיתפס. הם בדרך כלל לא ראוותניים או צעקניים. עם זאת, עם AI, שחקני איום יתחילו לעשות דברים כמו לקחת פרצות ישנות, מאגרי נתונים ישנים שהודלפו, ולאמן מודלים על המוצרים הישנים האלה ולמצוא דברים שהם לא מצאו בקלות קודם לכן. למשל לבקש מה־AI: 'תגיד לי בכל פעם ששם גברי אומר משהו פלרטטני לשם נשי' — זה מידע שיכול לשמש לסחיטה".

"יש לנו צוות שמוודא שהבינה המלאכותית לא עושה דברים שאינה אמורה לעשות. כמו למשל עידוד ילדים לעשן סיגריות או מתן הנוסחה לנשק כימי"

אגב סחיטה ואבטחה, תעשיית הסייבר מדברת בשבועות האחרונים הרבה על הפרצה שנחשפה ביישום XZ (יישום דחיסה בקוד פתוח שמשולב כרכיב יסוד במערכות, שירותים ויישומים רבים). הפרצה נחשבת למתוחכמת במיוחד: היישום תוחזק על ידי אדם אחד — לס קולין, היוצר שלו — שלאורך תקופה ארוכה היה תחת מתקפה חברתית שבסופה שוכנע להעביר את השליטה בקוד היישום למפתח אחר. זה היה למעשה שחקן איום שניסה ליצור באמצעותו "דלת אחורית" — שמאפשרת חדירה ושליטה במערכות ובשירותים שבהם היישום מותקן. אומרים שאם לא היו מזהים את זה בזמן, היה נגרם אסון מקוון נרחב. זו אמת או הגזמה?

"הדלת האחורית של XZ התגלתה על ידי עובד של מיקרוסופט, אנדרס פרנד, שעובד במשרדים בעמק הסיליקון. הוא מפתח, הוא לא איש אבטחה. והוא איתר את הדלת האחורית. כשרואים את ההודעות שפרסם בנושא, רואים שהוא לאט לאט מבין מה הולך שם וממש משתגע. כשהוא מבין שנפתחה פה דלת אחורית למערכת שמנהלת תקשורת מוצפנת בין מחשבים, הוא חושב שזה יכול להיות קטסטרופלי".

מה לטעמך הסכנה המרכזית שעולה מהאירוע הזה?

"שקיים מנגנון שדרכו שחקני איום יכולים להיכנס למערכות בשקט, וקשה מאוד לזהות אותם. זה מראה ששרשרת אספקת התוכנה כל כך פגיעה. וזה לדעתי משהו שכתעשייה אנחנו צריכים לעבוד עליו יותר ברצינות".

מתקפה כזו, גם אם היא הראשונה מסוגה, היא בוודאי לא האחרונה. אילו לקחים אפשר ללמוד ממנה לעתיד?

"מיקרוסופט מאוד ממוקדת בהבנת מקור הקוד שאנחנו משתמשים בו ובהבנת האבטחה שלו. מנכ"ל מיקרוסופט סאטיה נאדלה שלח מכתב לעובדים, שבו אמר שאבטחה היא בראש סדר העדיפויות שלנו כמפתחים, כמהנדסים, כחברה. אנחנו חברה של מהנדסים, והפוקוס צריך להיות באבטחה. גם אם יש לך עבודה אחרת, אתה קודם כל עושה אבטחה. אבל לא רק מיקרוסופט, כולם צריכים לדעת ממה מורכבת התוכנה שבה הם משתמשים: מאיפה בא הקוד? האם אנחנו מקבלים עדכונים עליו? האם הוא נשמר ביציבות? אם יש מתחזק אחד אני לא מאשימה אותו. הוא קורבן. אבל צריך להבין אם אתה מסתמך על משהו שמתוחזק בצורה שברירית כל כך".