שוברת קודים

איך תדעו אם תמונה אמיתית או מזויפת? שובם של סימני המים

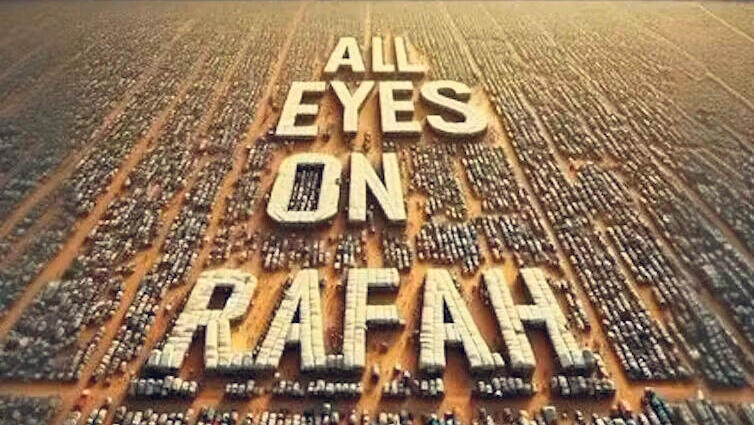

תמונה ויראלית שנוצרה בעזרת בינה מלאכותית וגויסה לסולידריות עם רפיח הציתה דיון על היכולת לזהות תוצרים ריאליסטיים אך לא אותנטיים. עולה השאלה מה הטעם בכלים שמתריעים על תוצרי AI אם קל לעקוף אותם, אלא שהם דווקא מונעים הפצת מידע לא אמין

במשך חודשים מתנהל דיון סביב מבצע צה"ל ברפיח. כחלק מהדיון החלו פעילים פרו־פלסטיניים בקמפיין משל עצמם שקיבל את הסיסמה הפשוטה "כל העיניים על רפיח" או "All Eyes On Rafah". הקמפיין השתמש בשתי אסטרטגיות דיגיטליות: זיהום אלגוריתם והצפה, והוא גם שם פוקוס על הכלי של סימני מים דיגיטליים - אותו סימון "דהוי" על גבי תמונה, שנועד ליצור זיהוי עם היוצר ולמנוע העתקה, או שימוש ללא רשות - בגרסתו החדשה והמתוחכמת יותר, ובעיקר על השאלה מה היכולת ומה הטעם בניסיונות לסמן תוכן לא אותנטי. אחת השיטות עבדה, והיא מרמזת על לקח אחד לפחות בנוגע לתוצרים סינתטיים של בינה מלאכותית גנרטיבית: התכלית של סימני מים עובדת, סימני מים עצמם - לא.

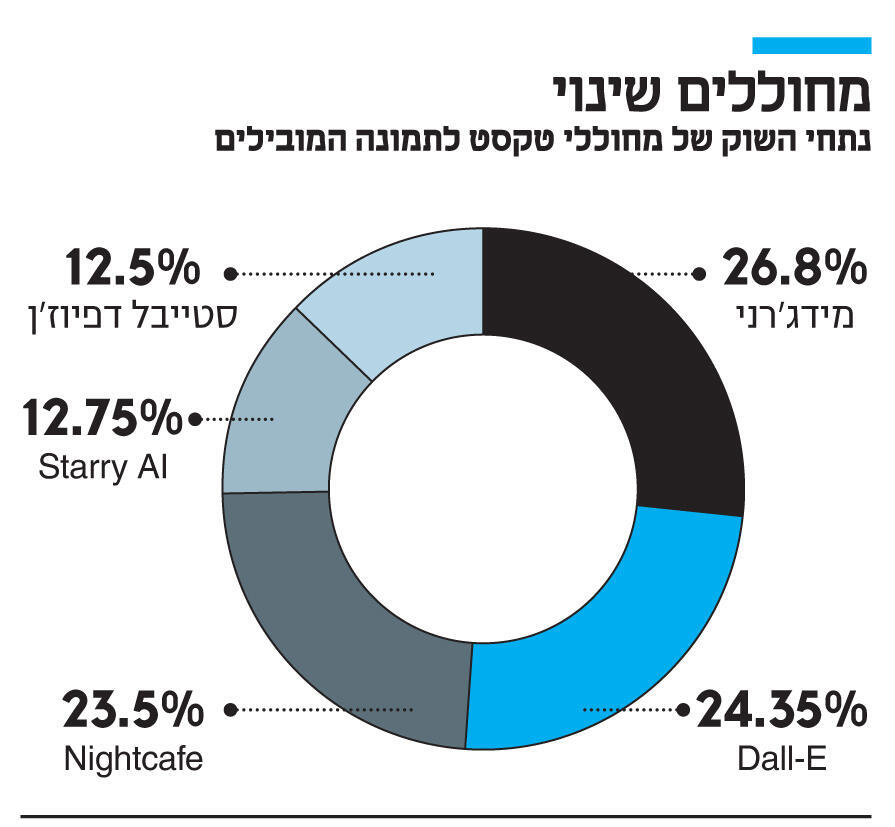

זיהום האלגוריתם היה יעיל למדי - יוצרי תוכן, בעיקר בטיקטוק, החלו להפיץ סרטונים על רפיח, תוך שתייגו אותם בהאשטגים לא קשורים, לרוב רמזים על סיפור רכילותי סביב סלבריטאים שמושכים עניין ציבורי גבוה כדי לגרום למשתמשים לצפות בתוכן פוליטי בזמן שציפו לתוכן הוליוודי. אחד פופולרי במיוחד היה סביב התיוג "מה טום הולנד עשה לזנדאיה", בהתייחס לזוג השחקנים המפורסם. מעל כל זה בלט קמפיין ספאם מבוסס בינה מלאכותית גנרטיבית שכלל הפצת תמונות סינתטיות בדרגות ריאליזם שונות, שמתארות סצנות מדומיינות בעזה. בשבועיים האחרונים נראה כי אין פינה באינטרנט שלא גדושה בתמונות שנוצרו ב־Dall-E או מידג'רני עבור המטרה הפרו־פלסטינית. לטרנד זה יש זרז בולט אחד: הוויראליות של תמונה אחת כזו שבה נראה לכאורה מחנה פליטים ומעליו הכיתוב "כל העיניים על רפיח" באנגלית.

2 צפייה בגלריה

"מה טום הולנד עשה לזנדאיה". תיוג עם שמות השחקנים המפורסמים לפוסט על רפיח

(צילום: שאטרסטוק)

משבר הידע בעידן הדיגיטלי

התמונה שהתחילה את הטרנד לא נוצרה לאחרונה, אלא ב־14 בפברואר על ידי משתמשת בשם Zila AbKa ששיתפה את התמונה שיצרה בקבוצת פייסבוק עם רבע מיליון משתמשים בשם “Prompters Malaya”. מדובר בקבוצה פעילה לחובבי מודלים טקסט־לתמונה, שבה נוהגים לשתף תמונות היפר־ריאליסטיות שמתעסקות בנושאים כמו חתולים, משפחה, פרחים או גיבורי על. מאות תמונות עולות לעמוד מדי יום בגאוות יצירה, והמשתמשים מציעים זה לזה טיפים כיצד ליצור דימויים אחרים או לתקן את הקיימים. כשפורסמה התמונה המקורית של AbKa, היא כללה סימן מים שציין כי היא "נוצרה באמצעות AI על ידי Zila AbKa", כראוי לאדם שחותם את שמו על תמונה שיצר. באותה העת התמונה עוד לא זכתה לעניין מחוץ לגבולות הקבוצה.

לפני כשבועיים דבר מה השתנה. משתמש אינסטגרם לקח את התמונה, הסיר את סימן המים, התאים את מידותיה לפורמט התמונות של אינסטגרם והפיץ אותה מחדש ללא קרדיט. התמונה הפכה ויראלית. "47 מיליון שיתופים על פני כדור הארץ", כתב מנהל קבוצת Prompters Malaya בפוסט שבו הכיר ב־AbKa כיוצרת המקורית של הדימוי הוויראלי. "הדימוי המוכר ביותר בעולם היום. ברכותיי AbKa, מי ייתן ותגמולך יהיה לנצח. אמן", וסיכם במסר לעולם: "מי אמר שתמונות מבינה מלאכותית לא יכולות לנער את העולם, ואולי גם להציל חיים".

מתגובתה של המשתמשת AbKa עצמה לא ניכר שהיא מוטרדת מזכויות יוצרים או מהמניפולציה שעברה התמונה שיצרה. "שבחיי לאלוהים", AbKa הגיבה, "אף שהיא נוצרה רק מ־AI, הדבר החשוב הוא המטרה שלה לפתוח את עיניהם של אנשים רבים... שהניצחון יהיה שלהם בפלסטין... והוא שייך לנו כבני אדם", כתבה בפוסט. ל־AbKa אולי לא אכפת שסימן המים שלה הוסר בקלות, אבל מה ניתן ללמוד מכך בכל זאת? לא מעט.

בחודשים האחרונים מדברים לא מעט על העידן החדש של "סימן המים", מעין סטנדרט שנוצר על ידי חברות בינה מלאכותית גנרטיבית, שנועד לכאורה לפתור את כל בעיות ההטעיה והזיוף שהם הפוטנציאל ההרסני הגדול של המודלים האלו. תחילה זו היתה בקשה פשוטה שהגיעה מצד חוקרים בתחום, שטענו כי יש לחייב את החברות להוסיף את הסימן באופן אוטומטי לכל יצירה שהמחוללים שלה כמו ג'ימני של גוגל או Dall־E של OpenAI מפיקים. המטרה היא שכל משתמש, גם אם מעולם לא נתקל בתוצרים של בינה מלאכותית גנרטיבית, יידע מיד כי מה שהוא רואה הוא תוצר של מחשב, לא תמונה אמיתית. הנימוק היה פשוט — קל היום לייצר תמונות ברמת ריאליזם משתנה ובעלות נמוכה. ריבוי ואיכות הדימויים שמופצים בכמויות גדולות באינטרנט מקשים על משתמשים להבחין בין תמונות אמיתיות למומצאות, ותורמים למשבר הידע שקיים בין כה וכה בעידן הדיגיטלי. כמה קל לייצר תמונות כאלו? לפי הערכות שונות, כ־34 מיליון תמונות נוצרות כל יום באמצעות מחוללי התמונות, סך הכל 15 מיליארד תמונות מאז השיקו מוצרים אלו לפני כשנתיים.

לא נרשמה היענות משמעותית מצד החברות. ככל שהזמן עבר ניכר היה שהן עוסקות בעיקר בפיתוח המוצרים, ולא מקדישות זמן ומשאבים ראויים לציון לבטיחות והגנת המשתמשים. בהתאם, ולאור העלייה בפופולריות של כלים אלו, גבר הלחץ מצד המחוקקים. בנובמבר ממשל ביידן קבע את סימונים אלה כפתרון מחייב בצו נשיאותי, ובחקיקה של האיחוד האירופי שהושקה במאי חייבו חברות להוסיף סימן מים לכל תוכן שנוצר על ידי בינה מלאכותית.

איך "לשבור" את סימני המים

בסופו של דבר סימני מים הושקו, וכהרגלן של חברות טכנולוגיה, הם הושקו במסגרת מיני־מרוץ חימוש כשכל אחת מתפארת בפתרון שיצרה: סימן מים מוטמע בפיקסלים, סימן מים מוטמע בסמל שבו גם מצויים נתוני מטא על היוצרים, סימן מים כדפוס נסתר בטקסט, סימן מים שלא ניתן לראות אותו בעין האנושית, סימן מים שניתן לראות אם לוחצים על התמונה. פתרונות על גבי פתרונות. מהר מאוד התברר, כפי שניכר ממקרה "כל העיניים על רפיח", שכל העבודה של חברות הטכנולוגיה אינה עונה על הדרישות ושלהסיר סימני מים זה לא אתגר גדול מדי. בפברואר פרופסור למדעי המחשב במרילנד פרסם מחקר שבו הראה כיצד הצליח "לשבור" את כל סימני המים (זאת אומרת להסיר אותם), הוא גם הראה כיצד ניתן להוסיף סימני מים בקלות לתמונות אמיתיות כדי לבלבל עוד יותר את המשתמשים. במאי מחקר נוסף הוכיח שוב את חולשת הכלי.

מכאן עולה לקח לא קטן: לא רק שאנחנו למדים כי החברות לא פועלות באופן ראוי לציון להגן על המשתמשים מפני זיופים והפצת מידע כוזב באינטרנט, אלא שמן העבר השני אנו למדים כמה סימן מים הוא חשוב. כל עוד הסימן היה נוכח על התמונה, הוויראליות שלה היתה מצומצמת - אנשים לא נמשכים לדימויים שכוללים תזכורת תמידית שהם אינם דימויים אותנטיים ושנוצרו על ידי מכונה. זאת אומרת שגם אם סימן מים לא עובד, הרעיון מאחוריו נכון - סימון תמונות שנוצרו על ידי בינה מלאכותית גנרטיבית מאט את תפוצתן של זיופים.

זה לא משנה אם כוונותיה של AbKa טובות או אפילו אם משתמשים אחרים מזהים שמדובר בתמונה לא אמיתית, כשמפיצים דימויים ותמונות באינטרנט ומייחלים לוויראליות של אלו, זו צריכה להתקיים תחת תנאים שבו כל מי שנחשף לאותם דימויים יכול לזהות מיד שהם אינם דימויים אמיתיים. כמה זה חשוב? אף שהתמונה נראית לעין מאומנת כתמונה שנוצרה על ידי בינה מלאכותית, כל עוד אין סימן מים, רבים יירתעו מלקבוע כי היא אינה אמיתית. אנו רואים בבירור את ההשפעה של זה. הנה, למשל, האופן שבו התמונה דווחה על ידי כלי תקשורת ותיקים ואחראיים, שאפילו הם נמנעו מלקבוע חד־משמעית מה מקור התמונה: "סביר להניח שהדימוי הזה נוצר על ידי בינה מלאכותית", נכתב בוושינגטון פוסט; "מה שנראה ככל הנראה כתמונה שנוצרה על ידי בינה מלאכותית", כתבו בניו יורק טיימס.