שוברת קודיםהטכנולוגיה לא מטא: צוקרברג לא דואג לפרטיות שלנו

שוברת קודים

הטכנולוגיה לא מטא: צוקרברג לא דואג לפרטיות שלנו

פייסבוק מחקה את נתוני זיהוי הפנים של משתמשיה אחרי עשור של ביקורת ציבורית ותביעות משפטיות, אבל את הטכנולוגיה הבעייתית היא השאירה. אין סיבה להריע לה

לקח לפייסבוק פחות משבוע כדי למנף את שינוי שמה ל”מטא”. במהלך שבוע שעבר הודיעה החברה שהיא תפסיק להשתמש בטכנולוגיית זיהוי הפנים שלה על גבי הרשת החברתית פייסבוק. מוצר זה איפשר למשתמשים זיהוי אוטומטי של אנשים בתמונות, תיוג וקישור אליהם בלחיצה קצרה. את ההחלטה, שהגיעה אחרי עשור של ביקורת ציבורית ושורה של תביעות משפטיות, נימקה החברה בשיקולים מוסריים.

“שינוי זה מייצג את אחד השינויים הגדולים ביותר בהיסטוריה של הטכנולוגיה”, הסבירו בפייסבוק, במידה לא מעטה של הגזמה. “אנחנו מאמינים שהגבלת השימוש בזיהוי פנים לקבוצה מצומצמת של מקרי שימוש היא ראויה”.

כולם נגסו בפתיון. כותרות תיארו את ההודעה כ”מטלטלת” וכצעד שמגיע “בעקבות ביקורת ציבורית” והסבירו כי החברה מוחקת מיליארד תמונות(!) ולא פחות מ”מבטלת” את מערכת זיהוי הפנים שלה. ממש מוותרת על טכנולוגיה ומאגר עצום של נתונים, מתוקף צו מוסרי פנימי.

פרשנויות רבות הציעו הסברים למהלך: אולי זו סנונית ראשונה שמעידה על הפנמה מצד פייסבוק שהטכנולוגיה בעייתית, הכרה בהתנגדות הציבורית, הוכחה שאין טכנולוגיה שהיא בלתי נמנעת או בכלל איתות לרגולטורים שהיא יכולה לפקח על עצמה. יהיו הפרשנויות אשר יהיו - המסקנה המדכדכת היא שהתעלול עבד. ככל הנראה, לא למדנו דבר.

1. מחיקה חסרת משמעות למשתמשים

מערכות בינה מלאכותית זקוקות למערכי נתונים עצומים, מסווגים לקטגוריות, שמהם הן לומדות באמצעות הסקה סטטיסטית. כך, למשל, כדי שמערכת זיהוי הפנים של פייסבוק תוכל להבחין בין המשתמשים המגוונים שלה היא צריכה לחשוף את המערכת למאגר ויזואלי עצום שמוגדר על ידי פרמטרים ה”מלמדים” אותה להבחין בין קטגוריות שונות.

ככל שיהיו יותר פרמטרים, כך המערכת תוכל לבצע את עבודתה באופן מדויק יותר. את מערכת זיהוי פנים שלה פייסבוק מאמנת יותר מעשור והיא נחשבת לאחת המערכות המתקדמות והמדויקות ביותר בתעשיית הטק העולמית.

כשחברה מחזיקה בטכנולוגיה מסוג זה, עולות כמה שאלות: על בסיס אילו מאגרי נתונים אומנה המערכת, מי סיווג את הנתונים הללו ואילו פרמטרים וקטגוריות הופעלו עליהם. רק באמצעות שאלות אלה ניתן להעריך את טיבה של המערכת. כמובן שאין לנו מושג באמצעות אילו קטגוריות החברה אימנה את המערכת שלה, אבל אפשר להניח שזה נעשה באופן דומה לסטנדרט בתעשייה שכולל סיווגים “אובייקטים” כמו גזע, מגדר, מין או גיל, ו”סובייקטיביים” כמו תכונות אופי, מראה או רגשות ותכונות כמו “שמח”, “עצוב”, “עשיר” ו“נכלולי”.

2 צפייה בגלריה

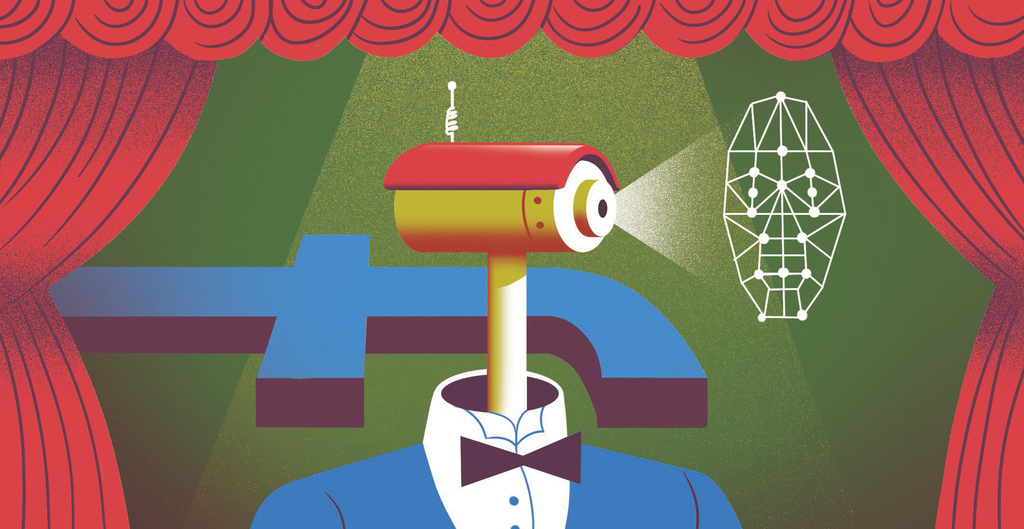

צוקרברג בזמן ההכרזה על השם “מטא”. גזענות אנושית מוטמעת בטכנולוגיה

(צילום מסך מפייסבוק)

בשלב הזה, שורה של הטיות (כמו למשל מי נראה כמו גבר, או איך מוגדר אדם שמח) הופכות לחלק אינטגרלי מהמערכת ולאמת הפסאודו־מדעית שלה. הטיות אלה הן הסיבה שרק בספטמבר השנה התנצלה פייסבוק על כך שהטכנולוגיה שלה התבלבלה ותייגה אנשים כהיי עור כשימפנזות. זו לא הפעם הראשונה שזה כמובן קורה. גזענות אנושית פשוט הפכה להיות מוטמעת בטכנולוגיה.

כשלים מסוג זה הופכים את הטכנולוגיה לבעייתית במיוחד, אבל בהודעה שלה בשבוע שעבר פייסבוק לא אמרה שהיא מוחקת את הטכנולוגיה שעליה עמלה יותר מעשור. החברה מציינת באופן חד־משמעי שהיא שומרת על DeepFace - האלגוריתם שמפעיל את תכונת זיהוי הפנים שלה לתיוג תמונות.

האם למחוק מידע אבל לא את האלגוריתם, משמעו שמחקת את המידע? לא ממש. האם השימוש שבו עשו המשתמשים בטכנולוגיית זיהוי הפנים היה אי פעם הבעיה? בהחלט לא. הבעיה תמיד הייתה בכך שאחת מחברות הטכנולוגיה הדורסניות ביותר בנתה ומשתמשת במערכת זיהוי ביומטרי, מסווגת מידע בידיים הלא אחראיות שלה ומפעילה את הפרמטרים המוטים שלה על פלטפורמות שבהם משתמשים מיליארדי משתמשים. האם משהו מזה משתנה? לא. לכן, אין כאן שום דרמה או שינוי טקטוני בתעשיית זיהוי הפנים. אין כאן דבר.

2. אם העתיד הוא מטא

ובכן, לא בדיוק שום דבר. מחיקת מאגר הנתונים וההודעה על הפסקת השימוש בטכנולוגיה מביאים לפייסבוק שורה של הישגים: תפיסת מרחק מטכנולוגיה שנתפסת היום כרעילה, גריפת הון פוליטי וציבורי (כפי שהיא אכן הצליחה) ומניעה של אפשרות עתידית שמאגר הנתונים יעבור אי פעם ביקורת או יאמן מערכות מתחרות.

אף שזו גישה פרשנית צינית לפעילותה של פייסבוק, זו אחת שהחברה הרוויחה ביושר אחרי שהפגינה במשך שנים אדישות גמורה לפרטיות ולרווחת משתמשים ומינפה כל נתיב – מפוקפק ככל שיהיה - לייצר הכנסות.

לציניות יש גם בסיס יותר קונקרטי, שנוכח באופן לא מתנצל ממש באותה הודעה על הפסקת השימוש בשבוע שעבר. “אנחנו מאמינים שלטכנולוגיה הזו יש פוטנציאל לאפשר בעתיד שימושים חיוביים ששומרים על פרטיות, שליטה ושקיפות”, אמר דובר מטא. “זו גישה שנמשיך לחקור כשאנחנו שוקלים כיצד פלטפורמות המחשוב והמכשירים העתידיים שלנו יכולים לשרת בצורה הטובה ביותר את הצרכים של אנשים”. כלומר, טכנולוגיית זיהוי הפנים דווקא כן תופעל, כנראה, במוצרי ה”מטאוורס” העתידיים.

הבחנה זו מהותית, שכן לאחרונה הודיעה פייסבוק על שינוי המותג ל”מטא”, שינתה את לוגו החברה והצהירה כי ליבת פעילותה היא כבר לא הרשתות החברתיות, אלא אותה מציאות וירטואלית אלטרנטיבית - המטאוורס. במילים אחרות, היא מגדירה עתיד חדש לחברה וטכנולוגיה זו צפויה להיות חלק אינטגרלי מעתיד החברה.

ואם היא כורכת את ליבת פעילותה ועתידה עם מערכת זיהוי הפנים, אפשר בהחלט להסיק מכך כי אין למוסר או לאיזה צייטגייסט קשר להחלטת החברה להגביל את השימוש בטכנולוגיה.

זאת ועוד: בפייסבוק כבר הודיעו כי הם עמלים על שורה של מוצרים שנועדו לאסוף מאסה אדירה של נתונים חדשים שתסייע לטכנולוגיות הקיימות לתמוך במפלצת המטאוורס שלה.

בין השאר, השיקה המפלצת של מארק צוקרברג את פרויקט Aria שכולל משקפיים התומכים במציאות רבודה במטרה למפות שטחים ציבוריים ופרטיים, החלה למכור משקפי שמש של המותג ריי־באן שמצלמות ומסריטות את המרחב מנקודת מבטו של העונד אותם ותשיק בשנה הבאה קסדת מציאות מדומה חדשים בשם Cambria שתכלול חיישנים שעוקבים אחרי תנועת עיניים ופנים. בקיצור, המון מידע צפוי להיאסף על המשתמשים בעתיד הקרוב.

די ברור מדוע פייסבוק/מטא מעוניינת בכך שנראה בהכרזה שלה מעין מחווה גדולה לאנושות, אך גם ברור ש־DeepFace הוא חלק אינטגרלי ממה שהחברה רואה ומסמנת כעתיד שלה וכעתיד הבלתי נמנע של האינטרנט. הדבר היחידי שנותר כשאלה פתוחה הוא מדוע אנחנו כל כך ממהרים להאמין לכל מה שהיא מבטיחה.