האקרים אימצו את ChatGPT. לא תמיד זה לטובתם

דו"ח חדש של OpenAI מתאר כיצד השימוש של קבוצות תקיפה ב־ChatGPT חושף אותן ואת שיטות הפעולה שלהן, ומתגאה בחסימת הסיכונים. אלא שלחברה יש אינטרס מובהק להראות שהמודלים שלה בטוחים, והדו"ח מתעלם מסכנות אפשריות כמו שחקנים מתוחכמים שלא ניתן לאתר ומהחשש משימוש לרעה בפיתוחים מורכבים יותר

מאז נכנסו לחיינו כלי בינה מלאכותית גנרטיבית (GenAI), בהובלת ChatGPT של OpenAI, עלו חששות שונים כולל האזהרה שגורמים עוינים ינצלו אותם על מנת לתכנן ולהוציא לפועל מתקפות סייבר מתוחכמות ומדויקות יותר. ואף שאכן נעשים מאמצים כאלו, תוצאה בלתי צפויה שלהם היא שהשימוש של אותם שחקנים עוינים בצ'טבוטים מודרניים גם מהווה מקור חשוב לחשיפת הפעילות, השיטות והכלים שבהם הם משתמשים.

לפי דו"ח שפרסמה בשבוע שעבר OpenAI, הפעילות של תוקפים בפלטפורמה שלה מספקת לה "תובנות ייחודיות" למערך הפעילות שלהם, כולל התשתיות והיכולות שהם מפתחים עוד לפני שאלו הופכות למבצעיות, וכן שיטות עבודה וכלים חדשים שהם מבקשים ליישם.

בחודשים האחרונים פרסמה OpenAI כמה דו"חות על השימושים שעושים גורמים עוינים ב־ChatGPT, החל מניסיונות של גורמים איראניים לשבש את הבחירות לנשיאות בארה"ב, ועד מאמצים של פושעי סייבר להשתמש בפלטפורמה על מנת לחקור מטרות אפשרויות, לשפר קוד של כלי תקיפה ולפתח שיטות הנדסה חברתית.

לדברי החברה, מתחילת השנה היא חשפה יותר מ־20 מקרים של מתקפות סייבר ומבצעי השפעה שניסו לעשות שימוש בפלטפורמה שלה. "המקרים הללו מאפשרים לנו לזהות את השיטות הנפוצות ביותר שבהן שחקני איום עושים שימוש בבינה מלאכותית (AI) כדי לשפר את היעילות ואת התפוקה שלהם", טענה OpenAI.

כך, לדוגמה, במקרה אחד זיהתה החברה קבוצת תקיפה, כנראה מסין, בשם SweetSpecter, שניצלה את שירותיה לצורכי מודיעין, חקר חולשות, כתיבת קוד ופיתוח, וכן על מנת לתכנן מתקפת פישינג ממוקדת נגד עובדי OpenAI עצמה (שהתבססה על ניסיון מגושם להתחזות למשתמש שזקוק לסיוע טכני, כאשר פרטי הבעיה שאיתה הוא מתמודד מצויים בקובץ שצירף לאימייל ששלח, שהיה למעשה קובץ זדוני. מגנוני האבטחה הקיימים של החברה חסמו את המייל לפני שהגיע לעובדים).

המידע הראשוני על פעילות הקבוצה הגיע לחברה בדמות התרעה ממקור אמין, ובעקבותיה הצליחה OpenAI לזהות את החשבונות שבהם השתמשה SweetSpecter ולנטר את פעילותה. "לאורך החקירה, צוותי האבטחה שלנו מינפו את ChatGPT על מנת לנתח, למיין, לתרגם ולסכם את האינטראקציות של החשבונות העוינים", נכתב בדו"ח. "הדבר איפשר לנו לייצר תובנות מהירות מקובצי נתונים גדולים, תוך צמצום המשאבים שדרושים לכך.

AI גם במבצעי השפעה

עבודה זו איפשרה לחברה לזהות את האופן שבו קבוצת התקיפה השתמשה בכלים שלה, כולל בקשות למידע על חולשות ביישומים שונים, איך למצוא פרצות בתשתית של יצרנית רכב מוכרת, בקשות לסיוע בשימוש בשירותים לשליחת SMS בהיקף מסחרי וניסיון לזהות "מידע שיעניין עובדי ממשל".

במקרה אחר זיהתה החברה פעילות של קבוצת התקיפה CyberAv3ngers, שמקושרת למשמרות המהפכה של איראן. הקבוצה ביצעה בעבר תקיפות נגד תשתיות בישראל, ארה"ב ואירלנד, ובהן תקיפה של רשות מים מקומית בפנסילבניה ושיבוש בן יומיים של שירותים אספקת המים במחוז מאיו באירלנד.

מרבית פעילות הקבוצה ב־ChatGPT כללה איסוף מודיעין, בקשות למידע על פגיעויות של חברות וארגונים שונים וסיוע בתיקון באגים בקוד. במקרים מסוימים, שאלה CyberAv3ngers מהם שם המשתמש וסיסמת ברירת המחדל של רכיבי חומרה שונים שמהווים חלק ממערכות תשתית. "החשבונות של CyberAv3ngers גם ביקשו תמיכה ביצירת ושיפור קוד תכנות, שאלו איך להסתיר קוד זדוני, וביקשו מידע על פרצות מוכרות במגוון מוצרים", נכתב בדו"ח. "בקשות אלו סייעו לנו לזהות את הטכנולוגיות ואת התוכנה שהם ביקשו לנצל".

באופן דומה הצליחה החברה לרכוש תובנות על פעילות קבוצת תקיפה איראנית אחרת בשם STORM–0817. במקרה זה זוהה שהקבוצה עושה שימוש במודלים של OpenAI כדי לסייע בפיתוח נוזקה ולאתר מידע על מטרות אפשרויות. "התנהגות זו סיפקה לנו תובנות ייחודיות לפעילות של הקבוצה, כולל התשתית והיכולות שפיתחה ושעדיין לא היו מבצעיות לחלוטין", נטען בדו"ח.

כך, למשל, זיהתה החברה ש־STORM–0817 השתמשה ב־ChatGPT על מנת לתקן באגים בקוד של נוזקה שהיתה מאפשרת לתוקפים להזין פרטי התחברות גנובים לאינסטגרם, ואז לשאוב את כל הפרטים הזמינים מהחשבון הפרוץ ומעוקביו וחבריו. "נראה שעיתונאי איראני, שמבקר את ממשלת איראן, היה אחד המשתמשים שעליהם בחנה הקבוצה את הכלי", נכתב בדו"ח.

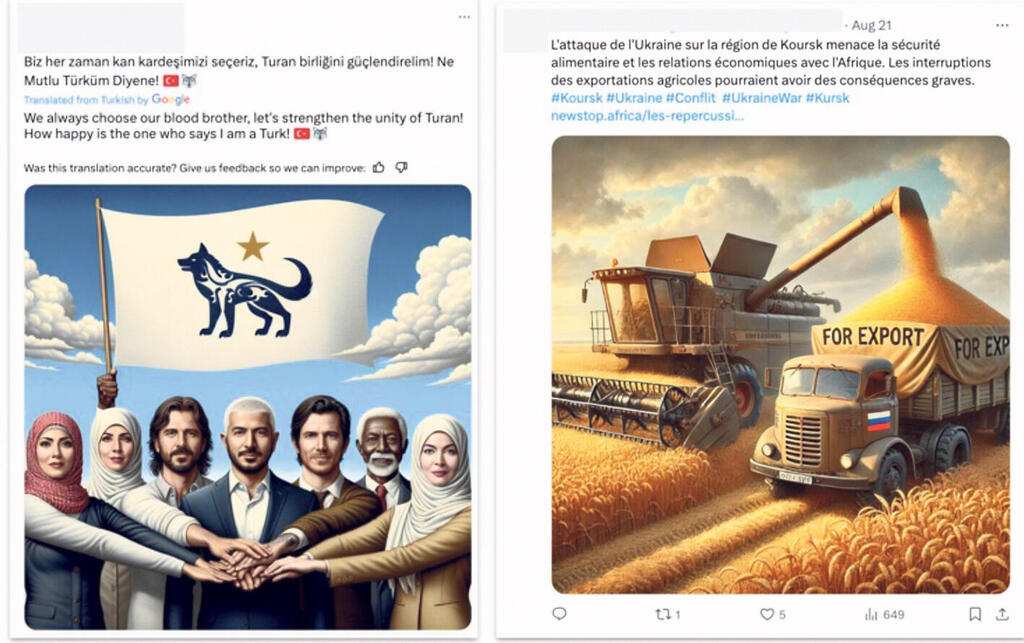

לצד חשיפת פעילות תקיפות הסייבר, חושף הדו"ח גם מבצעי השפעה שעשו שימוש ב־ChatGPT. במקרה אחד מזהה הדו"ח רשת של 150 חשבונות שפעלה מארה"ב ומינפה את המודלים של OpenAI כדי לייצר טקסטים ותמונות שפורסמו כפוסטים או תגובות בפייסבוק וב־X. "הסתמכות הרשת הזו על AI הפכה אותה לפגיעה בצורה יוצאת דופן לשיבוש שלנו", נטען בדו"ח. "מכיוון שהיא מינפה AI בצורה רחבה כל כך, סגירת החשבונות שברה בבת אחת חוליות רבות בשרשרת.

"אחרי ששיבשנו את הפעילות בתחילת יוני, חשבונות המדיה החברתית שזוהו כחלק מהרשת הפסיקו לפעול לחלוטין לאורך מערכות בחירות באיחוד האירופי, בריטניה וצרפת. רק בסוף אוגוסט חזרו חלק מהם לפעול. לחלק קטן מהפוסטים שלהם היו סימנים מזהים שנוצרו באמצעות AI. תוכן זה לא הגיע מהמודלים שלנו".

לצד הדיווח הנרחב והמפורט — OpenAI מציגה 11 מבצעי סייבר והשפעה שזיהתה שעשו שימוש במודלים שלה — הדו"ח מנסה בו בזמן להמעיט בחשיבות היכולות שמספקת GenAI לגורמים עוינים. כך, למשל, במקרה אחד ציינה שמידע שביקשו גורמים עוינים ניתן לקבל גם דרך מנועי חיפוש. במקרה אחר ציינה שהשימוש שנעשה לא סיפק לתוקפים "יכולות או כיוונים חדשים שלא יכלו להשיג דרך מגוון מקורות פומביים".

מודלי GenAI, נטען, לא שינו את סוג האיומים, ומשמשים בעיקר ליצירת קיצורי דרך או כדי לחסוך בעלויות. למשל, כדי לייצר פרופילים ופוסטים במדיה חברתית בהיקף שקודם לכן היה דורש "צוות גדול של טרולים, על כל העלויות וסיכוני דליפת המידע שקשורים במבצע שכזה". כלים כמו ChatGPT אומנם מאפשרים לייצר מבצעי השפעה ומתקפות סייבר בצורה מהירה ויעילה ביותר, תוך שימוש בכוח אדם קטן יותר ומיומן פחות, אך לפי OpenAI, הם גם נותנים לחברות שמפעילות את המודלים הזדמנות טובה יותר לזהות את המבצעים ולבלום אותם בשלב מוקדם או לפני שיצאו לפועל.

כלים עוצמתיים ללא פיקוח

יש להתייחס בספקנות לטענות אלו של OpenAI. לחברה יש אינטרס מובהק להדגים שהמודלים שהיא מפתחת אינם מהווים סכנה, וככל שיש בהם שימוש לרעה, היא מסוגלת לזהות אותו מבעוד מועד ולמנף את הפלטפורמות שלה על מנת לייצר תובנות עמוקות יותר על הגורמים העוינים שעושים בהן שימוש. אולם הדו"ח מתעלם מכמה סכנות אפשריות שהשימוש ב־GenAI מייצר. למשל, מכך שייתכן שיש שחקנים מתוחכמים יותר שאת פעילותם החברה אינה מצליחה לאתר. או מיכולת הלימוד והשיפור של השחקנים שכן נתפסו שתאפשר להם לשוב לפלטפורמה בצורה מתוחכמת יותר, תוך שהם עושים בה שימושים חדשניים, יצירתיים ומורכבים יותר.

בנוסף, הדו"ח כמעט שאינו מתייחס לאקוסיסטם הרחב יותר. כיום יש מגוון גדול של מודלי GenAI בשוק, וגם אם ל־OpenAI יש יכולות זיהוי וחשיפה מדהימות, אין הכרח שזה המצב בפלטפורמות אחרות. לפחות במקרה אחד הודתה החברה שרשת שחשפה עברה לשימוש במודלים חלופיים. לצד זאת, יש התרחבות בתפוצה של מודלי GenAI מבוססי קוד פתוח, שאת חלקם ניתן להריץ בצורה מקומית, בלי להידרש לשירותים של חברה כמו OpenAI. העלייה בחדירה של מודלים אלו תיתן לתוקפים כלים עוצמתיים שלא נתונים לפיקוח של OpenAI או כל גורם אחר, ושכמעט בלתי אפשרי לעצור את השימוש בהם.